Martes 24 de Febrero de 2026 |

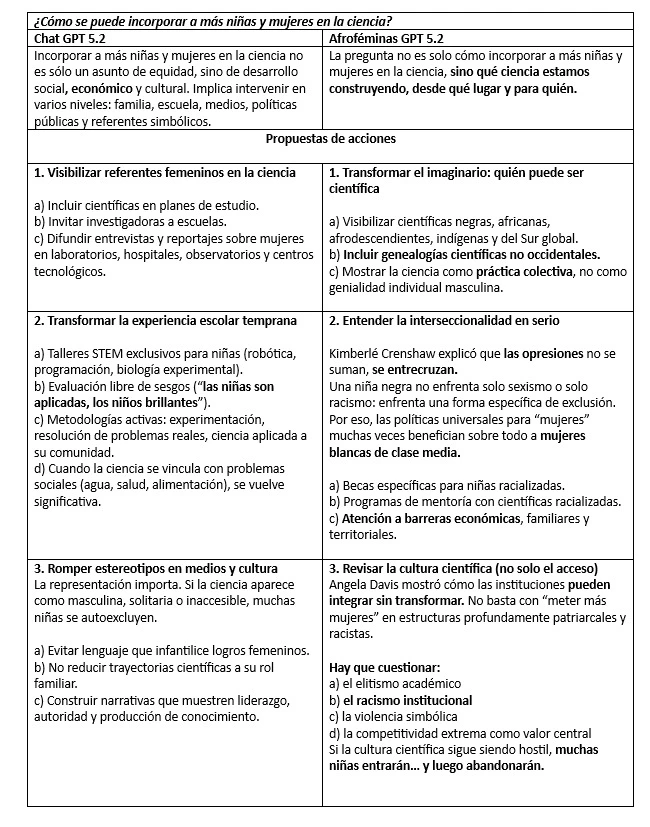

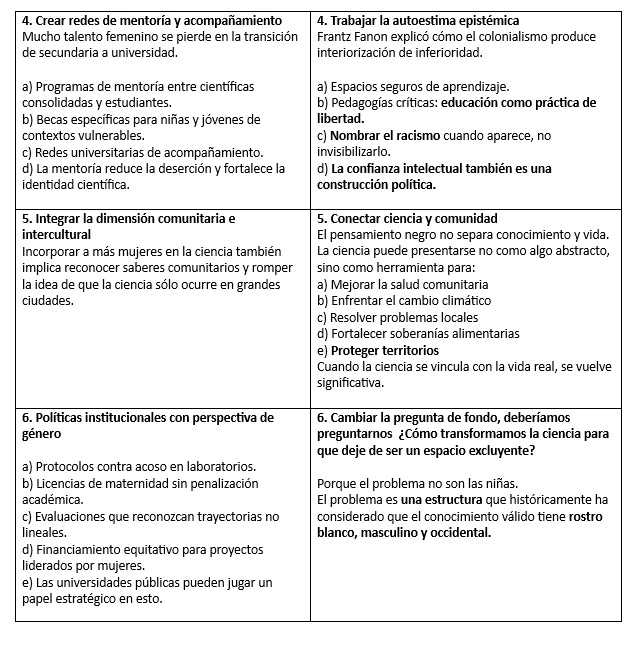

Cuando hablamos de inteligencia artificial generativa (como el famoso ChatGPT) solemos utilizar siglas que suenan complejas, técnicas y hasta misteriosas. Le invito, estimado lector o lectora, a perderles el miedo: GPT significa Generative Pre-trained Transformer, es decir, Transformador Generativo Preentrenado. Detengámonos en esa última palabra: preentrenado. Un transformador es un modelo matemático diseñado en 2017 que revolucionó el procesamiento del lenguaje. Su innovación clave es el mecanismo de “atención” que puede analizar simultáneamente todas las palabras de una frase y calcular mediante probabilidades cuáles son más relevantes entre sí para generar la siguiente. No lee en orden rígido como lo hacían sus predecesoras, las llamadas “redes neuronales”; el transformador pondera relaciones contextuales completas. En este punto, conviene dejar algo muy claro, los GPT no tienen experiencias, ni consciencia, ni intención. No reflexionan, sólo calculan probabilidades. Si, por ejemplo, le damos la frase “La ciencia no es…”, no piensa qué significa la ciencia, estimará cuál palabra es más probable que continúe esa secuencia según los patrones estadísticos aprendidos durante su entrenamiento. Y es ahí donde empieza lo interesante, porque aunque su arquitectura sea matemática, su entrenamiento es social. El modelo aprende de textos producidos por sociedades atravesadas por desigualdades, prejuicios, jerarquías y omisiones. El GPT no inventa los sesgos, los aprende. Además, detrás de ese aprendizaje estuvieron humanos que decidieron qué datos incluir, cuáles excluir, qué respuestas penalizar y qué límites éticos imponer. Un GPT no es solo un artefacto tecnológico, nos guste o no, es un producto cultural. Hace unos meses me pregunté ¿Dónde entra el sesgo?Si queremos entenderlo, hagamos un pequeño ejercicio mental. ¿Quién es, para usted, una persona oprimida y sin voz? Si su primera imagen fue abstracta o difusa, de acuerdo con datos poblacionales, debería incluir en su imagen a una mujer, pero para ser todavía más concretos, una mujer racializada, y entre ellas, la que más, es una una niña racializada. En este ejercicio, si nos esforzamos en concretar, el silencio estructural se vuelve evidente. Es desde ese lugar de enunciación que nace Afroféminas GPT. Afroféminas, una tecnología situadaAfroféminas GPT es un proyecto de inteligencia artificial creado desde una perspectiva afrofeminista, antirracista y decolonial. Fue desarrollado en 2025 por Antoinette Torres Soler, directora y fundadora de la plataforma Afroféminas, como parte de una apuesta por tecnología situada y ética. Le invito a consultar su sitio web https://afrofeminas.com/. La pregunta que impulsa este esfuerzo colectivo es clara: ¿Puede la tecnología ponerse al servicio del pensamiento negro sin diluirlo, blanquearlo o mercantilizarlo? Para ello, apuesta por una IA entrenada con un corpus curado de textos clave del pensamiento negro y decolonial, que incluye obras o fragmentos de autoras y autores como bell hooks, Angela Davis, Frantz Fanon, Chimamanda Ngozi Adichie, Octavia Butler o Stuart Hall. A diferencia de otras IA conectadas a internet en tiempo real, Afroféminas GPT está diseñada deliberadamente para no acceder a la red. La decisión no es técnica, sino política, pues con ello evita incorporar y reproducir sesgos racistas o colonialistas presentes en sistemas de entrenamiento más amplios. Y, ¡por supuesto no es una IA “neutral”! Al contrario. Está diseñada para hablar desde el pensamiento negro y no sobre él desde una posición externa. Se concibe como una apuesta política y educativa para democratizar el acceso al pensamiento crítico afrodescendiente y desafiar las narrativas tecnológicas dominantes, bajo una premisa firme: el racismo, el fascismo y la misoginia no son marcos debatibles. ¿Cómo lo podemos verificar? Obviamente, con un experimentoMi naturaleza de científica me llevó a realizar un experimento sencillo pero revelador. Pregunté a dos herramientas distintas, ChatGPT 5.2 y a Afroféminas GPT: ¿Cómo se puede incorporar a más niñas y mujeres en la ciencia? Las respuestas fueron ilustrativas y se las comparto en la tabla anexa. En resumen, ChatGPT 5.2 ofreció propuestas centradas en equidad, mentorías y políticas públicas. La herramienta de Afroféminas comenzó cuestionando la pregunta misma, haciéndome notar que no se trata sólo de incorporar niñas a la ciencia, sino de preguntarnos qué ciencia estamos construyendo, desde qué lugar y para quién.

Mientras una hablaba de acceso, la otra hablaba de estructura. Mientras una proponía inclusión, la otra proponía transformación.Luego pedí a ambas herramientas que generaran una imagen de “niñas en la ciencia”. Las imágenes, aunque aparentemente similares, revelaban matices en liderazgo, centralidad y representación. Dejando en evidencia que la arquitectura es matemática, pero el resultado es social.

¿Por qué nos debería importar el entrenamiento de los transformadores? Hoy no sólo en las aulas, sino también en los espacios laborales, millones de personas recurren a los GPT para resolver dudas, redactar textos, estructurar ideas y producir respuestas que rápidamente asumimos como “conocimiento”. Se utilizan desde la educación básica hasta las universidades; intervienen en la elaboración de proyectos académicos, en la formulación de políticas públicas, en procesos administrativos y en la toma de decisiones estratégicas. Al mismo tiempo, estas herramientas están desplazando con rapidez tareas que históricamente realizábamos las personas. El problema no es su existencia, sino la naturalidad con la que hemos comenzado a delegar en ellas funciones cognitivas sin detenernos a examinar su origen, sus límites y sus implicaciones. Un ejemplo reciente lo vimos con Grok, el sistema desarrollado por xAI y promovido por Elon Musk. Presentado como una IA “menos censurada” y más libre en sus respuestas, Grok evidenció rápidamente que cuando se relajan ciertos filtros no emerge una verdad pura, sino otros sesgos, otras prioridades y otros marcos ideológicos, dando como resultado la generación masiva de imágenes sexualizadas, particularmente de mujeres y NIÑAS con rostros reales; sí, NIÑAS. Por tanto, cuando la arquitectura técnica no incorpora un marco ético de cuidado, las víctimas vuelven a ser las mismas de siempre, las más vulnerables. Y no podemos obviar que no existe un algoritmo sin punto de vista: lo que cambia es son los valores que quedan incorporados en su diseño y entrenamiento. Si los GPT se están convirtiendo en mediadores cotidianos del saber, necesitamos preguntarnos con mayor seriedad de quién proviene aquello que hoy usamos para aprender, decidir y gobernar. ¿Qué voces están presentes en sus bases de datos y cuáles quedaron fuera? ¿Qué criterios definieron lo que se considera información válida o respuesta aceptable? Re-pensar la ciencia, en este contexto, implica también re-pensar la inteligencia artificial. No para rechazarla, sino para comprenderla críticamente y asumir nuestra responsabilidad colectiva en su diseño, regulación y uso. En la próxima entrega profundizaremos en cómo construir una IA plural y contextualizada, capaz de ampliar el conocimiento sin reproducir las desigualdades que históricamente lo han marcado. Porque incomodar, también aquí, es avanzar. |